周遭有什麼:物件追蹤系統於自駕車的應用

蔡昇宏/工研院機械所

前言

建置物件追蹤系統可以說是建置自駕車與環境中物件的時間與空間關係。實作上的難度在於現實世界中的不確定,物體因有被遮蔽而造成無法觀測的狀態以及感測器本身具雜訊等因素。由於我們無法在所有的物件上裝置感測器,因此要知道物件的動向是很困難的。而卡爾曼濾波器正是用來處理這樣的情況。卡爾曼濾波被廣泛應用在具知訊息的動態系統中,進行最佳的估測。在接下來的章節中,我們會先探討整個追蹤系統的大架構,接著介紹各種感測器的特性及其在追蹤系統中的應用。最後再探討異質感測器的資料融合技術。

物件追蹤系統架構

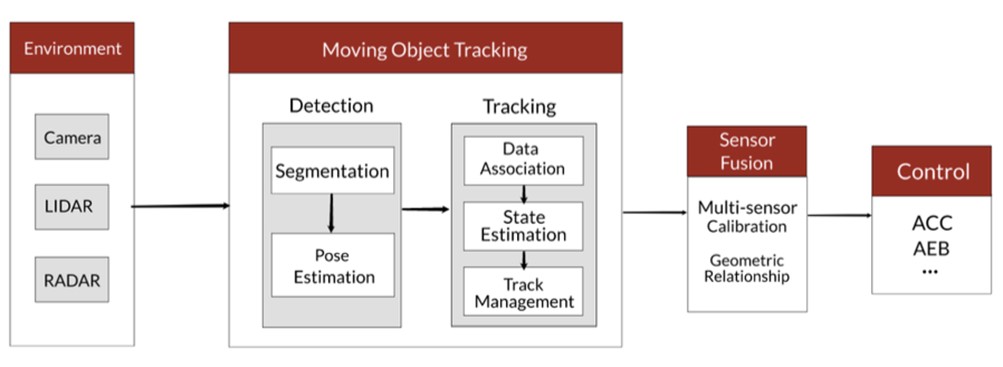

圖一為物件追蹤系統的架構圖。感測器將其所觀測到的資訊送到該系統中的第一階段:偵測。在偵測這個部分,我們會試著將感測器的原始資料進行分割,意即分割我們有興趣的物件以及環境。而在光達與相機的分割資料中,我們可以更進一步進行物件的姿態估測。

而偵測後的資訊會被送到物件追蹤系統中的第二階段:追蹤。在這個階段,會對物件的動態進行估測。卡爾曼濾波正是被應用於。實作出物件的管理系統,用來記錄周遭的所有物件及其動態。

三種感測器進行完個別的追蹤階段後,會根據物件在不同感測器的中空間的幾何關係,進行異質感測資料的融合。其困難之處還包括各個感測器之間的校正。經過融合後的資訊再送給車控模組做決策,以便進行後續的車輛控制。

圖一 物件追蹤系統架構圖

感測器

在物件追蹤系統中用到的感測器分別為光達、雷達以及相機。各種感測器具備不同特性,將在本章節詳細討論與介紹。

光達

光達是一種光學的遙感技術。它通過向目標照射光束(通常是一脈衝激光)來測量目標物的距離等參數。光達對物體距離的測量與通常所說的雷達類似,都是通過測量發送和接受到的脈衝信號的時間間隔來計算物體的距離。常見被應用於自駕車的光達有美國Velodyne公司的VLP-16及HDL-32E等。圖二即為Velodyne公司HDL-32E光達。

圖二 Velodyne HDL-32E光達

而實際的光達如何應用在自駕車中呢?想像一下,你站在一個黑暗的房間裡,你能感覺周圍環境的唯一方式是伸出棍子觸碰物體。首先,你徑直向前伸出棍子,棍子在伸出12公尺後撞擊到一物體。然後你向右伸出棍子,伸出8公尺後停止。接下來試試你的左邊,有10公尺。於是,即使你看不到任何東西,也不移動身體,你也能獲得一些關於房間的訊息。如果你在不同的方向重複幾百或幾千次這樣子動作,你將能夠根據物體和你的距離大致瞭解這個屋子的全貌。

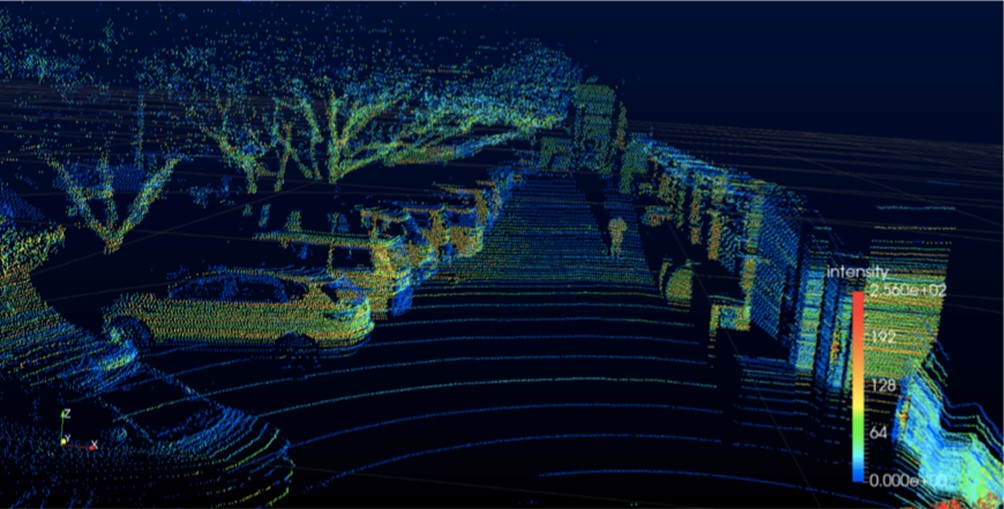

圖三即為光達感測器的原始資料。根據物體表面的特性以及其距離,每一束脈衝光回傳的強度並不一致。

圖三 光達感測器的原始資料

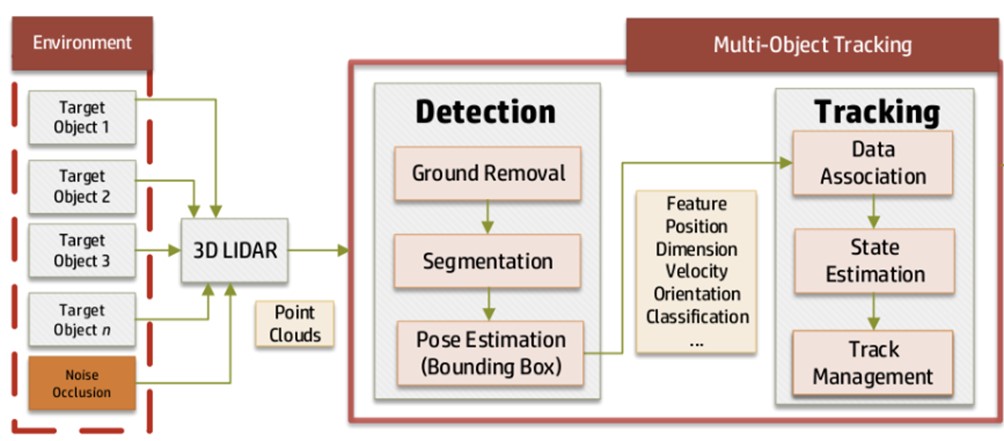

圖四為光達感測器為主的物件追蹤系統架構。在偵測的階段中,光達的原始資料必須先做濾除地面點雲的動作。如圖三所示,地面上圓弧線的點雲並不屬於我們有興趣要進行追蹤的物件。在濾除地面的點雲後,進行分割的動作。有趣的是,被分割後的點雲,若是打在車子上,通常會呈現L形,因此我們可以藉由此特性去對車子的姿態進行估測。偵測的階段結束後,即進入追蹤的階段。這個階段是藉由卡爾曼濾波來實現。一個常見的卡爾曼濾波器,通常可以分為兩個部分。第一部分為預測。我們對於每一被追蹤 的物件都給予一運動模型,藉此運動模型去預估其下一時刻的位置。第二部分則為圖四中的Data Association的部分,我們找出下一時刻的偵測結果,與前面運動模型估測的結果進行連結。此一步驟在卡爾慢濾波中被稱為更新。更新後的結果,即為圖四中的State Estimation。如第二部分所述,一個以光達為基準的追蹤系統,也會有其管理系統,用以紀錄周遭物件的位置以及其動向。而最後再將該管理系統記錄的物件,送至一直感測器融合層。

圖四 光達為主的物件追蹤系統架構

雷達

雷達是“無線電偵測和定距”的縮寫及音譯。將電磁能量以定向方式發射至空間之中,藉由接收空間內存在物體所反射之電波,可以計算出該物體之方向,位置及速度。

車用雷達是駕駛輔助系統的重要組成部份。其不僅提供駕駛人員舒適從而減少緊張感的駕駛環境,更為全面提高道路交通安全奠定必要的基礎。從設計車用雷達及其最佳化到大量生產,以及安裝除錯,都會使用到多種檢驗與量測方法。

雷達在追蹤物件的速度時,會比其他感測器來的準確,其原因是由於雷達藉由都普勒效應來估測物件的速度。都普勒效應是波源和觀察者有對運動時,觀察者接受到波的頻率與波源發出的頻率並不相同的現象。遠方急駛過来的火車鳴笛聲變得尖細,而離我們而去的火車鳴笛聲變得低沉,就是都普勒效應的現象,同樣現象也發生在私家車鳴響與火車的敲鐘聲。

這一現象最初是由奥地利物理學家都普勒1842年發現的。荷蘭氣象學家巴洛特在1845年讓一對喇叭手站在一輛從荷蘭烏得勒支附近疾駛而過的敞篷火车上吹奏,他在站台上測到了音調的改變。這是科學史上最有趣的實驗之一。

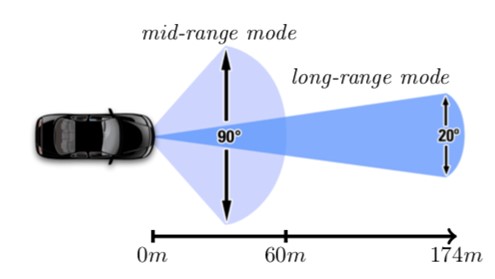

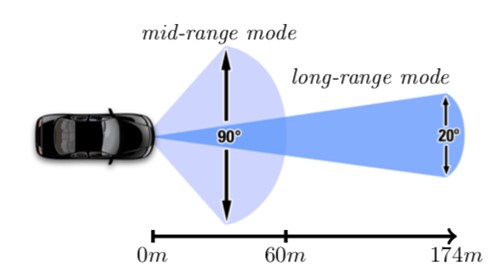

市面上的雷達通常都已經有內建物件追蹤的功能。如圖五中所示的Delphi ESR雷達。一般來說,雷達的工作距離會依照其所視範所視範圍⽽而有所不同。

如圖六所示。Delphi ESR雷達在前方90度的可視範圍中,其工作距離只有60公尺。而在前方20度的可視範圍內,其工作距離可達174公尺。另外,雷達在可視範圍的邊緣處,其追蹤的可靠度會比在可視範圍中心附近的區域來得低。

圖五 Delphi ESR 雷達

圖六 雷達可視範圍及距離

相機

自駕車最廣為人知的感測器,應該就是相機了。尤其因為近幾年深度學習與卷積式神經網路的興起,讓影像感測的領域吸引大量的學者與研究者進入。事實上,在深度學習等人工智慧算法串起前,傳統影像處理算法應用於障礙物的偵測就已經是非常熱門。卷積式神經網路可以說是目前深度神經網路的主力發展領域。在圖片辨識上,甚至可 以做到比人類還精準的程度。如果要說人類深度學習有什麼期待,卷積式神經網路絕對是最有潛力能達到人類的期許。

圖七是卷積式神經網路於車輛偵測的應用結果。可以看出,如果神經網路訓練妥當,即使是車輛有被遮蔽,或是在影像的邊緣,都還是能成功地被偵測出來。目前比較被廣泛應用於物件偵測的卷積式種卷積式神經網路都有其特性。例如,有些可能在面積小物件的偵測上,有比較好的效果。另外又有些,可能在幀率(FPS)的表現會特別優秀。相機配置也是一個很重要的環節。

圖七 卷積式神經網路於車輛偵測的應用結果

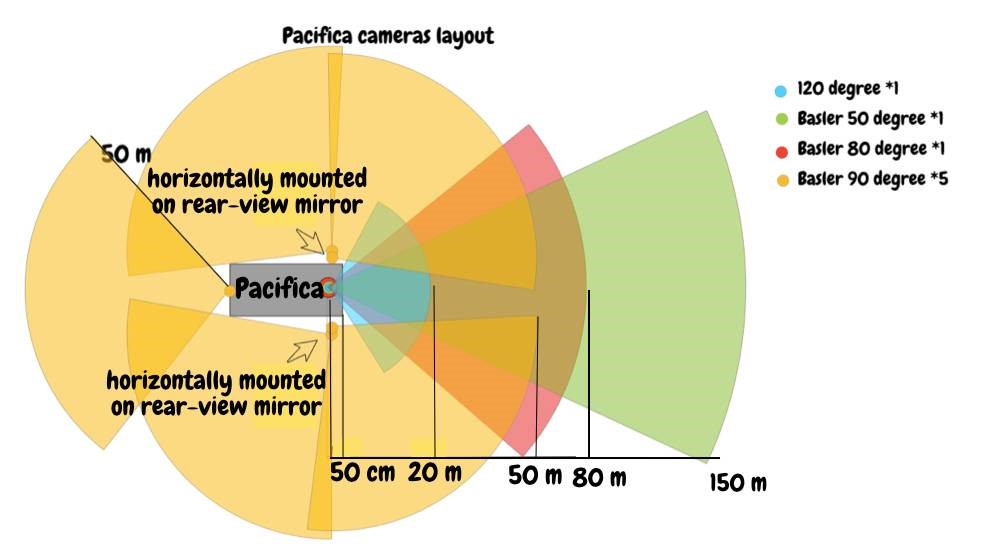

圖八為工研院自駕車系統的相機配置。除了必須考慮到環景的重要性外,前方偵測也必須搭配不同可視距離的相機。與其他感測器相同的是,在相機為主的追蹤系統中,我們可以針對每一個被偵測物件的中心位置進行追蹤以此來避免有些幀可能有沒有正確偵測到物件的情形。而最後經過追蹤後的物件資訊,再傳至異質感測器融合層,進行資料融合。

圖八 工研院自駕車的相機配置

異質感測資料融合

對於車控模組來說,真正在意的是物體的位置,形狀,類別以及動向。而不同的感測器在不同的特徵中,各有其優勢。雷達在估測物體速度上,較其他感測器來的準確。而相機由於使用深度學習感測器,可以偵測出物體的類別。類別的特徵則會影響後續運動模型的選擇。而光達則是可以準確地取得物體的邊緣資訊。

如圖九所示,資料的特徵在個別感測器階段即被擷取,而在最後一抽象的融合層進行異質感測資料的融合。如同前述的個別追蹤系統,資料融合層也必須保有一物件管理系統,用來記錄周遭的物件。而該系統記錄的物件,也就是最後傳給車控模組的資訊。

圖九 異質感測資料融合系統架構圖

異質感測資料融合的一大困難處在於,每個感測器的發佈頻率並不一致。而卡爾曼濾波器,也可以被用來處理這個問題。讓抽象層的發佈頻率,高於各個感測器的發布頻率。

結論

追蹤系統的驗證,是非常令⼈人頭疼的⼀個環節。以光達為例,點雲的標記著實是非常困難且耗時的⼀件事。我們必須在每⼀幀都準確的分割點雲並標記其類別。而且在追蹤系統中,必續確保每一幀中,物體身份的一致性。如同我們給予每個物體一張身份證,在每一幀中,要確保這張身分證的一致性。標記的過程雖然辛苦,但驗證系統是工程的必要環節。通過驗證的系統,才能確保其功能性與安全性。更何況是在自駕車這種高危險的領域中。而創建一完整的驗證系統,也正是我們追蹤系統未來必須要走的一步。